Ne aflăm în plină efervescență digitală, o epocă a big data și a Internet of Things (IoT) ale cărei efecte sociale, economice și politice influențează viața fiecărui individ. Inteligența artificială (IA) și sistemele care folosesc machine learning joacă un rol tot mai important și, chiar dacă ne aflăm la începuturile explorării funcționalităților acestora, există certitudinea că aceste tehnologii sunt componente indispensabile ale viitorului.

În acest moment, inteligența artificială este deja încorporată în smartphone-uri, motoare de căutare pe internet, asistenți virtuali, sisteme de recunoaștere vocală, facială sau a imaginilor, procese decizionale automate în domenii precum publicitate, marketing sau comerț electronic. Diferite dispozitive omniprezente în viața de zi cu zi, între care roboți, automobile autonome sau drone, folosesc și ele inteligența artificială.

Beneficiile și provocările digitalizării

Beneficiile utilizării IA variază de la îmbunătățirea calității vieții individului și a mediului până la eficientizarea activității entităților private. Astfel, implementarea conceptului de smart city, care implică inclusiv utilizarea IA pentru controlul traficului și reducerea ambuteiajelor, contribuie la îmbunătățirea calității vieții. Managementul energiei cu ajutorul noilor tehnologii contribuie la protejarea mediului. Pentru companii, inteligența artificială își arată beneficiile în elaborarea profilurilor de clienți, optimizarea procesului de recrutare și eficientizarea proceselor de intelligence competitiv.

Pe de altă parte, avansul tehnologic digital accentuează slăbiciunile umane. Se poate observa receptivitatea crescută față de fake news sau teorii conspiraționiste, stimulată de modul în care este prioritizat și personalizat fluxul de informații în diferite aplicații în funcție de comportamentul online al individului.

Cea mai serioasă amenințare pe termen lung își are originea în modul și scopul în care sunt concepute aplicațiile, unele urmărind încălcarea unor principii consacrate, de necontestat: libertatea de exprimare, protecția datelor cu caracter personal și libertățile politice. Putem aminti, aici, scandalul Cambridge Analytica, de exemplu, care a arătat cum cantități uriașe de date personale pot fi folosite pentru manipulare electorală.

Etica IA, între control și absența regulilor

Sistemul de tip MATRIX care combină toate aspectele ciclului de informații – colectare, stocare, procesare, analiză și diseminare – a fost anticipat de Central Intelligence Agency (CIA) încă din anii ’80, perioadă în care tehnologia IA era considerată de mulți o pură ficțiune. În 1983 a luat ființă Artificial Intelligence Steering Group (AISG), structură care transmitea managerilor din CIA rapoarte lunare privind stadiul cercetării și dezvoltării inteligenței artificiale pe diferite segmente: procesarea limbajului natural (lingvistică computațională), baze de date cu interfață inteligentă, sisteme de recunoaștere a imaginilor, interpretarea semnalelor sau managementul datelor spațiale și geografice. De asemenea, AISG recomanda susținerea dezvoltatorilor de IA atât din mediul profesional cât și academic și crearea unei platforme open-source bazată pe inteligență artificială pentru agențiile guvernamentale.

Agențiile de securitate și intelligence captează, de câteva decenii, date obținute prin supraveghere. Potrivit rapoartelor oficiale ale autorităților de control, în 2017 au fost înregistrate 15 mandate destinate interceptării în masă a telecomunicațiilor, aproape 100.000 de itemi individuali fiind accesați numai de MI5. Dezvăluirile făcute de Edward Snowden privind sistemul sofisticat de supraveghere folosit de NSA arătau avansul tehnologic atins în anul 2013. În prezent, putem doar intui stadiul atins de capabilitățile de supraveghere.

La nivelul organizațiilor internaționale ONU, UE, Consiliul Europei sau al statelor democratice sunt depuse eforturi pentru reglementarea utilizătii tehnologiilor bazate pe IA, din dorința de a proteja drepturile fundamentale ale omului. În 2019 UE a publicat ghidul „Orientările în materie de etică pentru o IA fiabilă”, document care prevede cerințele necesare respectării principiilor legale și etice, respectiv: implicare și supraveghere umană; robustețe tehnică și siguranță; respectarea vieții private și guvernanța datelor; transparență, diversitate, nediscriminare și echitate; bunăstare socială și de mediu; responsabilitate. Strategia europeană în domeniul inteligenței artificiale reprezintă o provocare majoră, situată la intersecția dintre politică și înalta tehnologie, între nevoia legitimă de a oferi cetățenilor acces cât mai larg la noile tehnologii și respectarea drepturilor și libertăților fundamentale.

Cele două fețe ale tehnologiei

În iunie 2020, Statele Unite ale Americii au anunțat public că dispun de un set de principii care reglementează operațiunile ce implică utilizarea IA, și anume: respectarea legii și a integrității profesionale; transparență și responsabilitate; obiectivitate și echitate; dezvoltare și utilizare centrate pe factorul uman; securitate și reziliență; parteneriat public-privat (între intelligence și mediile științific și tehnologic). De asemenea, a fost elaborat un ghid etic privind achiziționarea, proiectarea, dezvoltarea, utilizarea, protejarea, consumul și managementul inteligenței artificiale și datelor aferente, potrivit căruia IA poate fi folosită: când constituie un instrument adecvat pentru îndeplinirea unui obiectiv, după evaluarea potențialelor riscuri; într-o manieră care să respecte drepturile și libertățile individuale și să utilizeze datele obținute în conformitate cu normele legale; atunci când este testată, fiind luate în considerare potențialele riscuri asociate utilizării sale; în condițiile în care sunt comunicate scopul, limitările și rezultatele.

Dacă în democrațiile de tip liberal eforturile de reglementare a funcționării IA sunt centrate pe individ, în țările iliberale subiectul nu se regăsește pe agenda publică, represiunea digitală fiind o constantă care afectează profund relația dintre cetățean și stat. În China, inteligența artificială a fost folosită pentru extinderea, la nivel național, a sistemului de credit social. În funcție de comportamentul în societate, fiecare cetățean primește un scor care îi permite sau blochează accesul la diferite servicii publice.

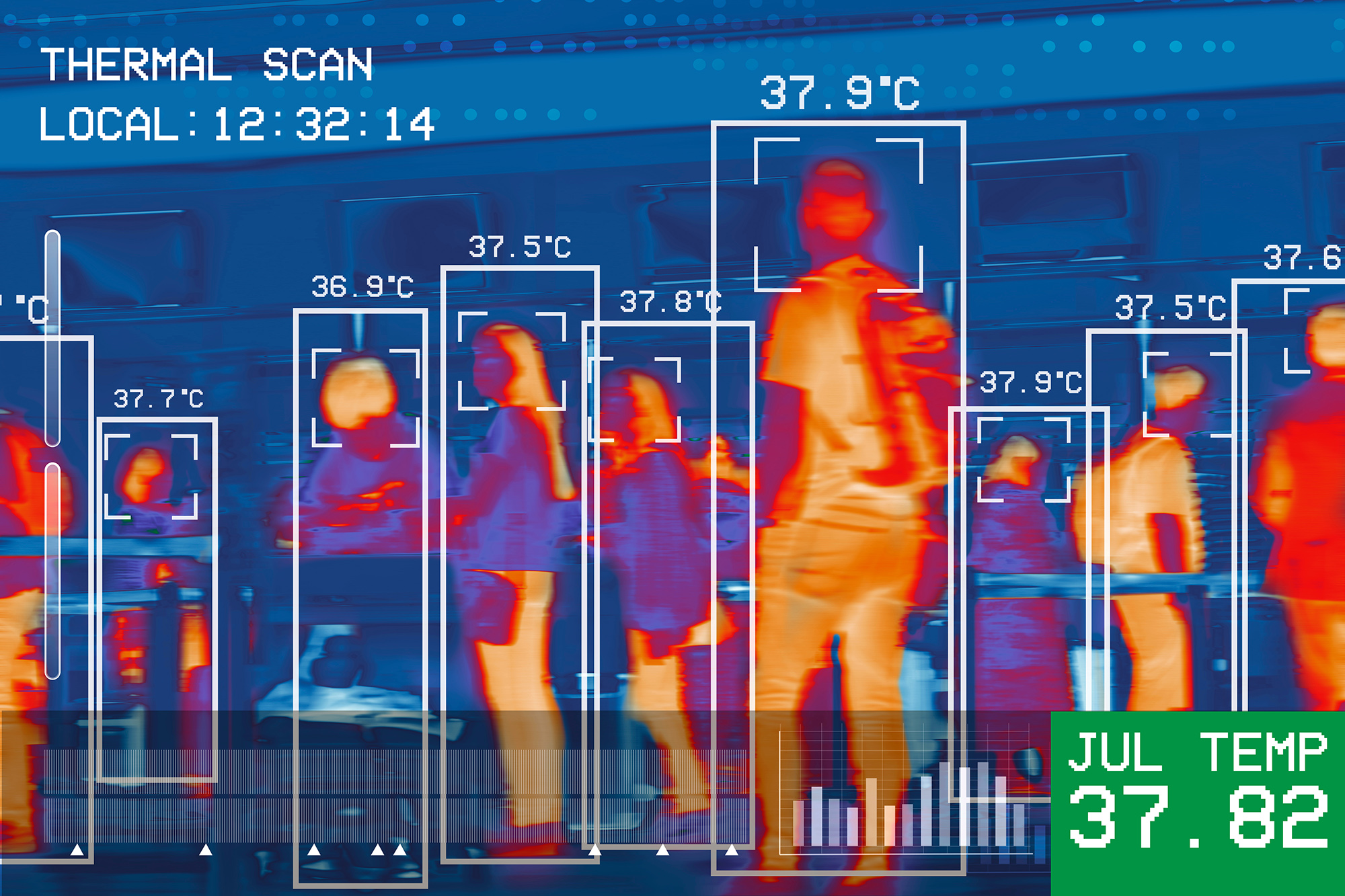

Supravegherea în timpul pandemiei

Pandemia pare să fi accelerat utilizarea IA pentru implementarea măsurilor de supraveghere. Astfel, supravegherea biometrică, localizarea, restricționarea circulației și punctarea riscurilor au generat modele noi de control social.

Printre cele mai invazive astfel de abordări au fost cele ale Chinei și Israelului. În ceea ce privește Beijingul, tehnologia testată în Regiunea Xinjiang s-a răspândit rapid pe teritoriul țării și a fost exploatată pentru a gestiona criză pandemică. Dotările puse la dispoziția polițiștilor au fost impresionante: căști care utilizează inteligența artificială pentru recunoașterea facială și scanează temperatura corpului în timp real; aplicații de tip data mining ce emit coduri de culori pentru restricționarea circulației; camere de supraveghere personalizate care monitorizează ușile apartamentelor cetățenilor aflați în carantină.

În Israel, serviciul de informații interne, Shin Bet, a fost autorizat să utilizeze, pentru depistarea contacților, tehnologie creată, inițial, pentru combaterea terorismului. În Coreea de Sud, autoritățile publice s-au concentrat pe valorificarea unor date obținute din interceptarea comunicațiilor, iar în Singapore a fost folosită o abordare mai puțin intruzivă, cetățenii utilizând benevol aplicațiile smartphone care transmit autorităților istoricul de contacte, astfel încât și alți utilizatori ai aplicației, potențial infectați, să poată fi alertați.

În Europa, state precum Turcia, Polonia sau Marea Britanie au apelat la analizarea datelor obținute prin localizarea terminalelor mobile, iar în Republica Moldova, Lituania și România s-a recurs la activarea articolului 15 din Convenția Europeană a Drepturilor Omului care permite derogări de la aplicarea acestui act internațional în condiții de criză.

Modalitățile diferite de combatere a crizei sanitare au arătat că autoritățile, indiferent de tipul de regim politic, au fost nevoite să găsească un echilibru între sănătatea publică și drepturile omului. Provocările generate de crizele de securitate ale ultimului deceniu, migrația, terorismul sau pandemia COVID, subliniază importanța protejării și garantării drepturilor și libertăților omului, care par din ce în ce mai expuse riscurilor.

Abstract

The use of artificial intelligence has a huge impact on the fulfillment of fundamental human rights and freedoms. The regulation of AI systems and algorithms is a top priority for the international community, but so far no one has succeeded in developing a robust framework of legal mechanisms in this field. During the coronavirus crisis, surveillance activities have challenged authorities to find the right balance between public health and fundamental human rights.

Autor: Maria Gheorghe